Ani tá najsofistikovanejšia AI sa na mozog človeka nechytá: Pri vnímaní využíva nebezpečné „skratky“

Nový výskum poukazuje na to, že ani vyspelá umelá inteligencia nedokáže vnímať vizuálne vnemy tak, ako to dokáže ľudský mozog.

Nedávno vedci z York University publikovali štúdiu, v ktorej varujú pred potenciálnou hrozbou, ktorú môže predstavovať umelá inteligencia.

Vo svojej práci prízvukujú, že ani tá najkomplexnejšia umelá inteligencia nevidí objekty tak, ako ich vidí človek. Počas svojho procesu „rozmýšľania“ zároveň môže využiť skratky, ktoré by v určitých prípadoch mohli predstavovať riziko, ak sa AI uplatní v reálnom svete.

Vedci sa v tomto prípade pozreli na umelú inteligenciu DCNN alebo inak hĺbkovú konvolučnú neurónovú sieť. Vo sfére hĺbkového učenia sa tieto druhy neurónových sietí najčastejšie využívajú na analyzovanie vizuálnych obrazov. Konvolučné neurónové siete sa inšpirovali biologickými procesmi – presnejšie prepojením medzi neurónmi. Organizácia siete zodpovedá organizácii neurónov vo vizuálnom kortexe zvieraťa.

Konvolučné neurónové siete sa dokážu naučiť optimalizovať filtre cez automatizovanú formu učenia. Iné algoritmy pracujú s filtrami, ktoré museli programátori navrhnúť ručne. V tomto majú konvolučné siete výhodu, pretože dokážu pracovať aj bez predchádzajúcich informácií, či zásahu človeka. Ako však dokazuje aj nový výskum, stále nie sú dokonalé a môžu mať svoje muchy.

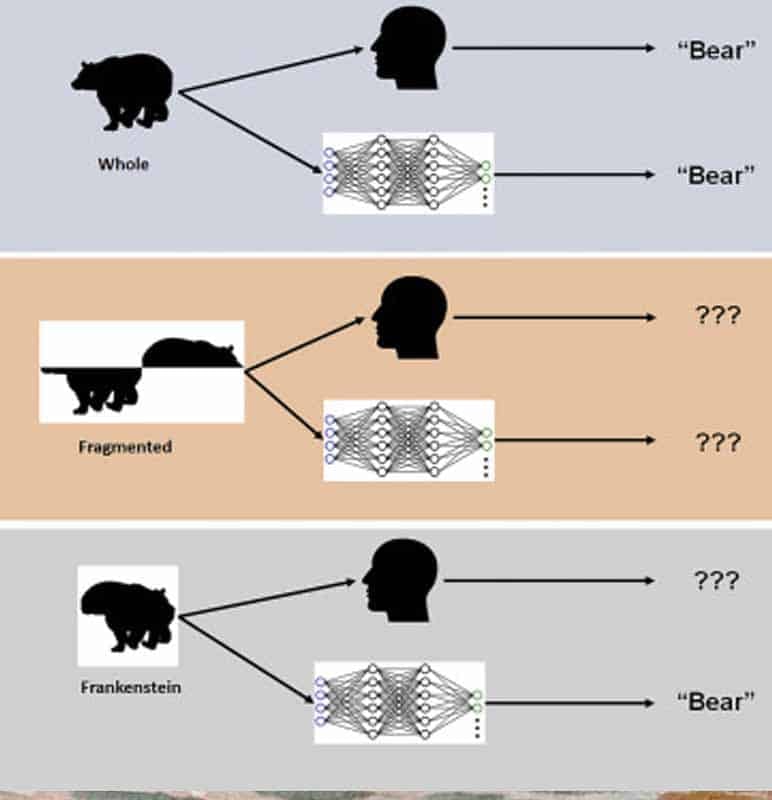

Vo svojej štúdii vedci využili takzvaných „frankensteinov“, teda vizuálne obrazy, ktoré vedci rozložili a následne ich dali dokopy nesprávnym spôsobom. Obrazy majú správne charakteristiky, no tie sa nachádzajú na nesprávnych miestach. Výsledky experimentu ukázali, že nás ľudí dokážu frankensteini zmiasť, no umelú inteligenciu nepomýlia. To značí, že nie je citlivá na konfiguráciu určitého objektu.

Neprehliadnite

Nedostatky v reálnych situáciách

„Výsledky našej práce naznačujú, že hĺbkové modely umelej inteligencie za určitých podmienok zlyhajú. V tomto prípade by sa mali brať do úvahy procesy, ktoré idú za priamočiare rozpoznávanie objektov, ak chceme zistiť, ako náš mozog spracúva vizuálne vnemy,“ vysvetľuje profesor James Elder, jeden z autorov štúdie.

Ďalej vysvetľuje, že hĺbkové procesy umelej inteligencie zvyknú využívať rôzne skratky. Tie môžu v mnohých prípadoch fungovať, no v reálnych situáciách by sa mohli ukázať ako nebezpečné. Ako príklad Elder uvádza situáciu z rušnej ulice. Autá, chodci, či cyklisti sa v očiach vodiča miešajú a vytvárajú „fragmenty“, ktoré si vie náš mozog spojiť dokopy a podľa toho zistiť, kto sa kde nachádza. Umelá inteligencia by v tomto prípade vnímala jednotlivé časti vizuálnych informácií individuálne a tým pádom by mohla zle vyhodnotiť možné riziká.

Ak však vedci vytvorili model presnejšie zodpovedajúci architektúre mozgu, výsledok nebol o nič lepší. Na základe toho predpokladajú, že ak sa chcú v budúcnosti vyrovnať schopnostiam ľudského mozgu rozpoznávať objekty, budú musieť zvoliť iný prístup. Domnievajú sa, že umelá inteligencia musí trénovať na oveľa väčšom počte objektov a nezameriavať sa len na správne zaradenie objektu do určitej kategórie.

Komentáre